Intelligence artificielle, nouvelle ère ?

Les nouveaux algorithmes générateurs d’images, textes, voix et vidéos bouleversent nos sociétés numériques. Jusqu’où et avec quelles conséquences ?

Enquête d’Adrien Denèle - Publié le

Un emballement sans précédent

En l’espace de quelques mois, l’intelligence artificielle (IA) a changé de statut : cessant d’être une technologie au parfum de science-fiction, elle s’est convertie en une réalité menaçante pour l’emploi, la fiabilité des informations et la sérénité des relations sociales. Et tout cela, grâce aux algorithmes développés par de jeunes entreprises privées jusqu’alors méconnues, comme OpenAI, fondée fin 2015 – par Sam Altman et Elon Musk, tout de même ! – société mère de ChatGPT. Cette IA conversationnelle est capable de rédiger à la demande de longs textes, des résumés, des poèmes et dissertations en un clin d’œil, grâce à une interface très ergonomique, accessible y compris aux plus jeunes. De leur côté, les générateurs d’images DALL·E et Midjourney imaginent sur demande les idées visuelles les plus folles, pour proposer « photos », dessins ou illustrations. DALL·E est détenu par OpenAI ; le programme Midjourney, par le laboratoire de recherche américain éponyme, qui employait moins de 20 personnes en juillet 2023 ! À ces IA aujourd’hui très connues s’ajoutent les vidéos de Stable Diffusion, un logiciel en open source, mais aussi les applications en musique, traitement de données et imitation de voix... L’apparition conjointe de ces nouveaux générateurs de contenus n’est pas due au hasard, mais à l’émergence de nouvelles technologies de calcul et méthodes d’apprentissage, couplées à des interfaces résolument grand public. De quoi battre tous les records. Ainsi en janvier 2023, trois mois seulement après sa mise en ligne, ChatGPT comptait déjà plus de 100 millions d’utilisateurs. Un engouement inédit pour une entreprise aussi jeune.

Le pape rhabillé par Midjourney

Hiver rigoureux au Vatican ? Reconversion dans le rap chrétien ? Ni l’un ni l’autre, mais une image très réaliste générée par l’IA Midjourney ! Bien sûr, un œil averti identifie des détails significatifs : aspect flou des contours, mains peu fidèles à la réalité… D’autres images, visiblement truquées, suscitent l’agacement ou l’amusement, comme celle du président français Emmanuel Macron en train de méditer en pleine rue durant la mobilisation contre les retraites, début 2023. Mais qui « scrolle » un réseau social à toute allure peut y croire. Ainsi, la fausse photo d’un homme âgé ensanglanté, durant les manifestations de début 2023, a suscité une indignation bien réelle.

La création artistique bousculée par l’IA

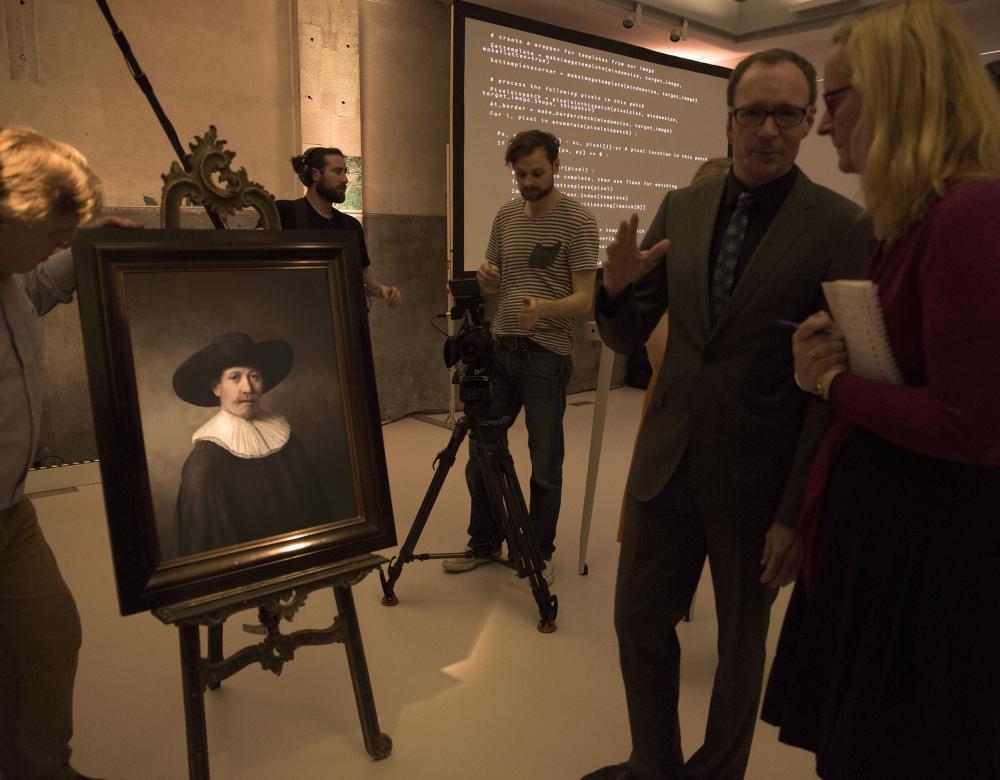

Voici un tableau de Rembrandt… que personne n’a jamais admiré dans un musée. Il est issu du projet d’IA The Next Rembrandt : la récolte des données de 346 tableaux de l’artiste néerlandais, leur compilation, leur analyse et l’entraînement de l’algorithme sur son style pictural. Mais l’IA conquiert surtout l’art contemporain. Ainsi, fin 2022, l’œuvre Théâtre d’Opéra Spatial remportait la compétition d’art digital Colorado State Fair. Une œuvre conçue par Jason Allen sur Midjourney, qui a suscité bien des débats sur la nature de la production artistique. Même scénario dans la musique, où un morceau peut être composé en quelques clics. L’idée derrière une œuvre primera-t-elle dorénavant sur le processus d’exécution ?

Une révolution pour le pire... et le meilleur ?

L’IA, une menace pour l’emploi ? Les économistes peinent encore à évaluer dans quelle mesure. Dans un rapport de mars 2023, le cabinet d’investissements Goldman Sachs estime que l’IA générative – la branche de l’IA consacrée à la production de données, images, textes et sons originaux – pourrait automatiser ou remplacer jusqu’à un quart des emplois aux États-Unis et en Europe : support administratif, services juridiques, architecture, ingénierie... En revanche, une étude de l’Organisation internationale du travail, publiée en août 2023, se montre plus rassurante : l’IA générative modifierait surtout « la qualité des emplois », notamment administratifs, grâce à l’automatisation des tâches. Dans tous les cas, l’ampleur et la rapidité de la transition en cours suscitent l’inquiétude. Des taxes sur l’automatisation sont d’ailleurs proposées depuis des années pour accompagner cette transition – par des juristes ou même par Bill Gates, l’ancien patron de Microsoft – mais ne sont toujours pas adoptées. Le tableau n’est cependant pas uniformément noir : l’IA permet d’automatiser les tâches rébarbatives comme la collecte de données, l’écriture de codes informatiques, les traductions routinières, la rédaction de contrats simples... Parfois, elle peut même améliorer la qualité du travail. Ainsi de certains diagnostics médicaux. Développé avec l’institut Curie, l’algorithme Galen Breast permet d’améliorer la détection d’un grand nombre de sous-types du cancer du sein. Autre exemple : selon une étude de la fondation indienne Lata Medical, le tracé cardiaque analysé par IA permet de prédire avec précision le diabète et même le prédiabète. Une méthode prometteuse dans les pays à faibles revenus.

ChatGPT à l’école pour quels usages ?

Depuis l’apparition de ChatGPT, des élèves cèdent à la tentation. Aussi des enseignants soumettent-ils les copies à des logiciels soi-disant capables de repérer « l’écriture IA », aux résultats hasardeux. À l’université Texas A&M, aux États-Unis, un enseignant a même demandé à ChatGPT s’il avait rédigé les rédactions de 15 étudiants, ce à quoi l’algorithme a répondu par la positive. Ce qui ne signifie pas grand-chose : des logiciels d’écriture classent aussi parmi les textes générés par IA… la Constitution américaine ou des passages de la Bible ! Des institutions préfèrent donc réguler les usages. Sciences Po Paris l’autorise sous certaines conditions et dans le respect d’une charte anti-plagiat.

Des algorithmes plus éthiques ?

L’IA tend à l’Homme le miroir de ses stéréotypes, comme l’ont révélé, lors des multiples demandes en ligne adressées à Midjourney, certains motifs récurrents et pour le moins dérangeants. Nourrie des bases de données disponibles sur internet, l’IA, en effet, en restitue les clichés. Ainsi, sommé de représenter un « voleur blanc », Midjourney a dessiné… un homme noir vêtu de blanc. Misogynie également, patente dans les premières versions de ChatGPT qui reléguaient souvent les femmes en cuisine. Depuis, les choses semblent s’être équilibrées, grâce à un entraînement affiné et surveillé par des entreprises propriétaires soucieuses de leur image.

Les algorithmes : quelles responsabilités ?

Les voitures autonomes ont inauguré le débat : si l’accident est inévitable, faut-il qu’une voiture fonce sur une personne âgée plutôt qu’un enfant ? Doit-elle sacrifier son conducteur et, sinon, à quel prix ? Et si oui, qui osera monter dans un tel engin ? Bref, quelle est la responsabilité légale de l’IA ? Récemment, des cas de suicide ont relancé la controverse. En Belgique, en mars 2023, un homme s’est donné la mort au terme de longues discussions avec Eliza, une IA conversationnelle. Qui est responsable d’un tel acte : le seul utilisateur, le concepteur du modèle d’IA, le diffuseur ? Le débat reste ouvert. Les lois sur la propriété intellectuelle, comme le copyright, constituent un autre casse-tête. Ainsi, les artistes ont fourni sur internet la quantité phénoménale d’œuvres d’art indispensable à l’entraînement des IA… gratuitement et sans droits d’auteur liés. Ne sont-ils pas en droit d’espérer une forme de rémunération ou de soutien ? Un premier procès a été initié en juin 2023 en Californie, aux États-Unis, contre OpenAI, pour violation du droit d’auteur. Le New York Times, CNN, Radio France ou TF1, entre autres, ont bloqué le robot d’OpenAI accusé de « piller » leurs contenus. Quant à l’Union européenne, elle souhaite se doter d’un cadre juridique complet pour clarifier les responsabilités. En amont des discussions avec les États membres, le Parlement a adopté le 14 juin 2023 un texte exigeant la transparence sur la production des contenus par l’IA et les données utilisées pour l’entraînement des algorithmes. Affaire à suivre, donc.

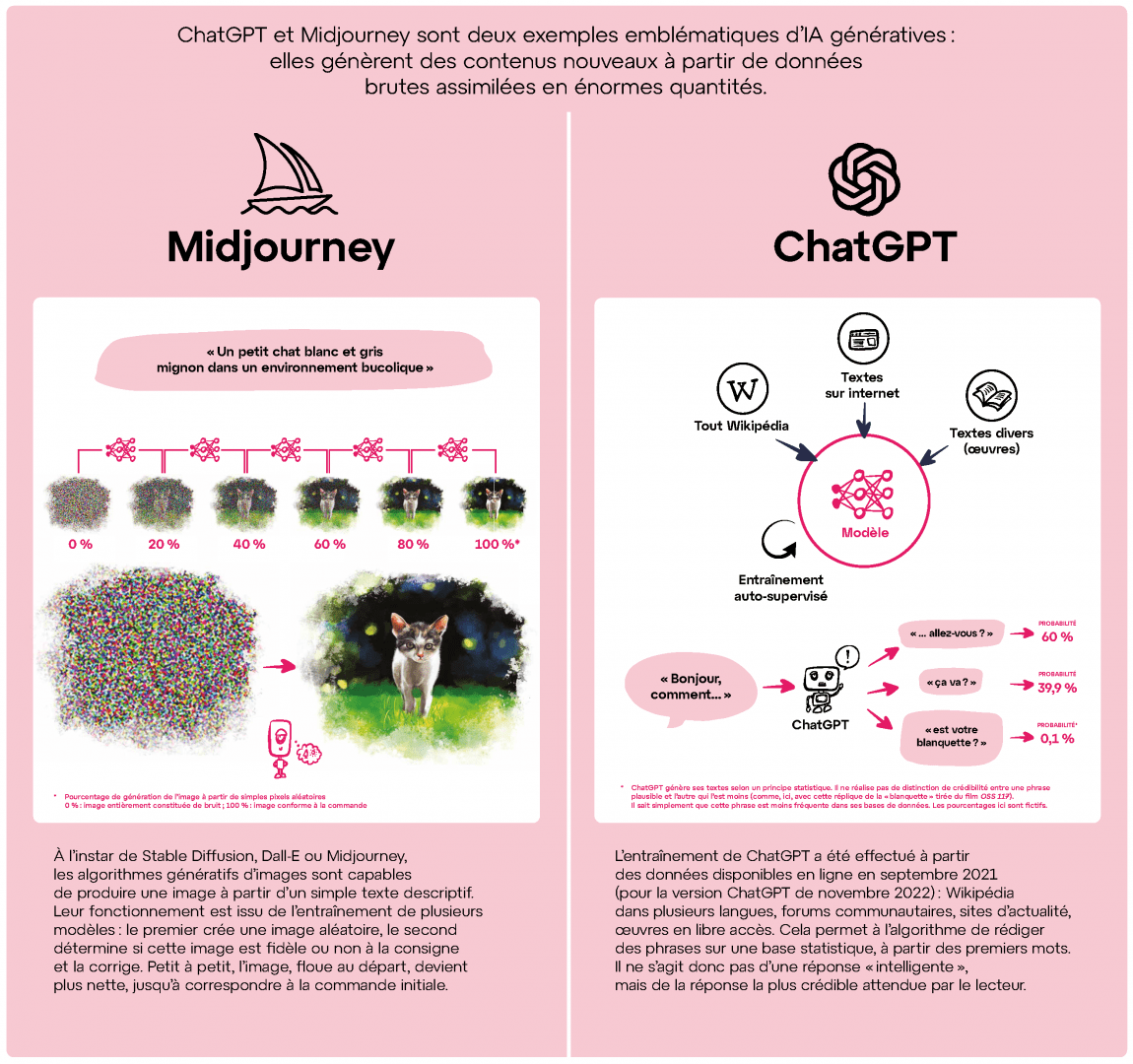

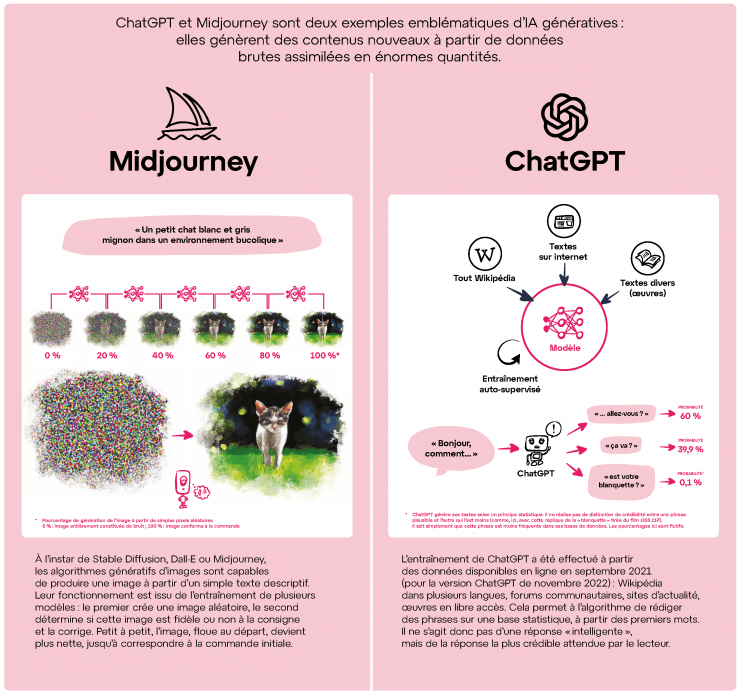

Les mécanismes de l’intelligence artificielle générative

Quand les Gafam courent derrière l’IA

Après avoir concurrencé les médias traditionnels, les géants du numérique craignent d’être dépassés à leur tour par l’émergence de l’IA, mais comptent bien participer à son essor. Notamment en prenant des parts dans les start-up à l’origine des nouveaux algorithmes d’IA générative, vite devenues des poules aux œufs d’or. Ainsi, Microsoft a investi dans OpenAI, un des principaux acteurs de la nouvelle IA, avec ChatGPT et DALL·E, ce qui a permis à l’entreprise fondée par Bill Gates d’intégrer un agent conversationnel à son navigateur internet Bing. Capable de répondre aux recherches avec précision, il rivalise désormais avec le moteur de recherche Google, longtemps réputé indétrônable. De son côté, la maison-mère de Google, Alphabet, semble avoir été prise de court. Mis en ligne en février 2023, Bard, son agent conversationnel, peine encore à convaincre. Quant au géant Meta (Facebook), très engagé dans le métavers, il peine à rivaliser. Mais cette société met en avant le caractère open source, c’est-à-dire au code accessible, de LLaMA, un modèle de langage moins lourd en données que ChatGPT. La version 2 est disponible depuis juillet 2023. Enfin, Adobe a intégré des fonctionnalités d’IA à Photoshop, son logiciel star de retouche photo et traitement d’images, pour rester compétitif. Des employés se sont même inquiétés de la viabilité du modèle économique : les principaux clients d’Adobe sont les graphistes... dont le travail est rendu en parti obsolète par l’IA. L’entreprise serait-elle en train de creuser sa propre tombe ? En attendant de le savoir, les sommes investies sont à la mesure des enjeux : près de 10 milliards pour Microsoft et Google. De quoi nourrir la course à l’innovation.

Les premiers films made in IA

Vous avez aimé les images ? Vous allez adorer les films ! Déjà, des vidéastes talentueux obtiennent des résultats intéressants avec des courts-métrages presque entièrement réalisés par IA. Aux êtres humains, la rédaction des consignes (y compris la description précise des plans), le choix et l’édition des images, l’amélioration du montage et des effets supplémentaires, le cas échéant. À l’IA, tout le reste ! Comme pour le court-métrage américain de science-fiction The Frost, ou le film de la réalisatrice française Anna Apter, /Imagine. Dans les jeux vidéo, les personnages « non-joueurs » sont désormais capables de soutenir des conversations longues et réalistes, en réponse aux questions du joueur.

Compagnons de solitude, vraiment ?

En février 2023, Snapchat, l’application populaire chez les 15-25 ans, mettait en ligne le chatbot My AI. L’idée : offrir la possibilité d’échanger avec une version simplifiée de ChatGPT. My AI retient les informations de l’usager, fournit des conseils personnalisés, rassure, console. Au risque d’enfermer des individus déjà vulnérables dans un rapport exclusif avec la machine, plutôt qu’avec d’autres êtres humains. L’OMS s’inquiète d’ailleurs ouvertement du manque de précaution dans la diffusion actuelle des usages de l’IA générative.

Vers l’ère du soupçon généralisé

L’IA générative inaugure-t-elle l’ère des fausses informations omniprésentes ? Pour l’heure, on s’amuse surtout des détournements, comme le faux débat sur Twitch entre le président américain Joe Biden et son prédécesseur Donald Trump, riche en invectives comiques. Mais que faire si des contenus induisent les électeurs en erreur ? Car les progrès techniques sont vertigineux et les documents générés par IA, très difficiles à identifier comme tels. Les géants du Net, à l’instar de Google avec SynthID ou d’OpenAI avec un filigrane visible, travaillent d’ailleurs sur des outils permettant de marquer les textes, images et vidéos générés par IA. L’enjeu est de taille : d’ici 2026, près de 90 % des contenus en ligne seraient produits artificiellement, estime l’Agence européenne de police criminelle Europol. Le soupçon pourrait aussi entacher les relations sociales. Début 2023, un homme d’affaires chinois s’est ainsi fait dérober l’équivalent de 570 000 euros suite à un appel vidéo : un escroc amateur d’IA ayant mimé la voix et le visage d’une connaissance l’avait aisément convaincu de « prêter » cette somme. De fait, l’IA pourrait conduire à la multiplication des escroqueries, facilitées par les données personnelles disponibles en ligne : contacts téléphoniques, galeries photos, vidéos sur les réseaux sociaux… Faudra-t-il un jour convenir d’un mot de passe au sein d’une même famille, pour prévenir toute usurpation d’identité frauduleuse ? Ou, pire encore, prévoir des protocoles systématiques pour prouver son appartenance au genre humain, au-delà des banals captchas aujourd’hui utilisés ?