Les « risques considérables » des technologies biométriques

Publié le - par LeBlob.fr, avec l’AFP

Pourriez-vous être emprisonné à tort à cause d’un système de reconnaissance faciale, ou écarté d’un entretien d’embauche parce qu’un ordinateur vous trouve nerveux ? Face à l’essor des technologies biométriques, la Défenseure des droits s’alarme dans un rapport publié lundi des « risques considérables » qu’elles comportent.

« Les avancées que permettent les technologies biométriques ne sauraient s’effectuer ni au détriment d’une partie de la population, ni au prix d’une surveillance généralisée », avertit cette autorité indépendante, dirigée par Claire Hédon.

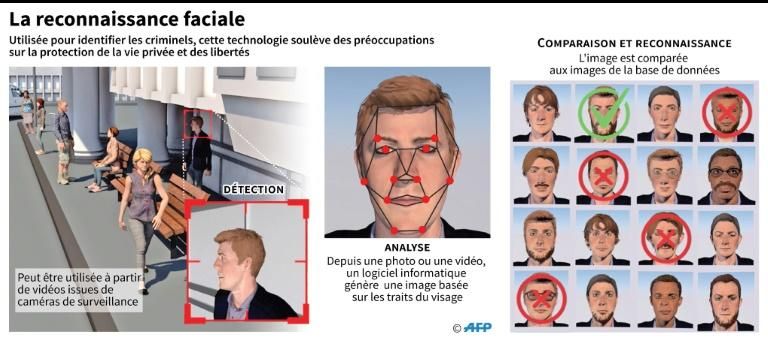

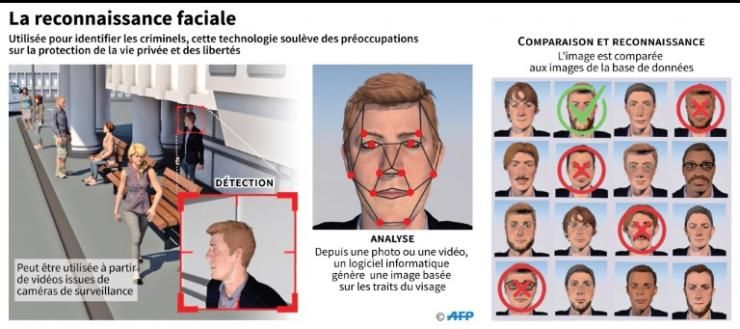

Depuis plusieurs années, ces technologies qui visent à authentifier ou identifier une personne, voire à évaluer sa personnalité, en analysant ses données biométriques comme les traits du visage, la voix ou les caractéristiques comportementales, se généralisent. Mais elles sont « particulièrement intrusives » et présentent des « risques considérables d’atteinte aux droits fondamentaux », selon le rapport.

Elles exposent d’abord à « une faille de sécurité aux conséquences particulièrement graves », explique la Défenseure des droits. Si un mot de passe peut être modifié après un piratage, impossible en revanche de changer d’empreintes digitales lorsqu’elles ont été volées dans une base de données. De quoi mettre « en danger l’anonymat dans l’espace public en permettant une forme de surveillance généralisée », selon l’institution.

Au-delà de la protection de la vie privée, le rapport pointe surtout le « potentiel inégalé d’amplification et d’automatisation des discriminations » des technologies biométriques, basées sur des algorithmes d’apprentissage. Or sous leur apparente neutralité mathématique, ils peuvent être discriminatoires, notamment à cause de bases de données inconsciemment biaisées. « Aux États-Unis, trois hommes noirs ont ainsi déjà été emprisonnés injustement suite aux erreurs de systèmes de reconnaissance faciale », rappelle le rapport.

Sécurité, ressources humaines, éducation... Les domaines concernés sont nombreux. Certaines entreprises de recrutement commercialisent déjà des logiciels assignant des scores aux candidats lors d’un entretien d’embauche. Et ce alors même que ces technologies visant à évaluer les émotions « commettent de nombreuses erreurs ». Le document pointe également « l’effet dissuasif » des technologies biométriques, qui peuvent par exemple décourager certains de manifester.

Pour un meilleur encadrement, la Défenseure des droits formule plusieurs recommandations. Elle appelle d’abord tous les acteurs, privés comme publics, à écarter les technologies d’évaluation des émotions. Concernant la reconnaissance faciale, déjà interdite par le Conseil constitutionnel pour les drones policiers, la Défenseure des droits estime qu’elle devrait également l’être pour d’autres dispositifs comme la vidéosurveillance ou les caméras piétons. L’institution réclame enfin l’instauration d’un « audit externe et indépendant » des dispositifs d’identification biométrique, et de contrôles réguliers des effets des algorithmes, « sur le modèle du contrôle des effets indésirables des médicaments ».